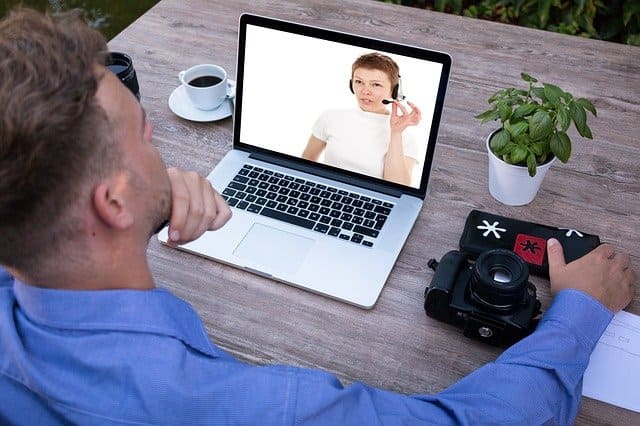

De acuerdo con el FBI, cada vez más personas recurren al uso de deepfakes para solicitar empleo. En un anuncio público, la agencia de investigación de EE.UU. dijo que ha recibido un aumento en las quejas sobre personas que superponen videos, imágenes o grabaciones de audio de otra persona sobre sí mismas durante entrevistas de trabajo en vivo.

La instancia aseguró que los reportes están vinculados a roles tecnológicos remotos que habrían otorgado a los candidatos exitosos acceso a datos confidenciales, que incluyen PII (información de identificación personal) del cliente, datos financieros, bases de datos de TI corporativas y/o información patentada, pero que de igual forma es preocupante el daño que las personas podrían sufrir al ser objeto de este tipo de fraude.

«El uso de la tecnología para acosar o dañar a personas comunes, que no llaman la atención del público y no pueden disponer de los recursos necesarios para refutar falsedades debería ser preocupante».

Departamento de Seguridad Nacional.

Los solicitantes fraudulentos de trabajos tecnológicos no son nada nuevo. En una publicación de LinkedIn de noviembre de 2020, un reclutador escribió que algunos candidatos contratan ayuda externa para apoyarlos durante las entrevistas en tiempo real y que la tendencia parece haber empeorado durante la pandemia.

Por ejemplo, varios headhunters descubrieron que en Corea del Norte, los estafadores se hacían pasar por entrevistados estadounidenses para las nuevas empresas de criptografía y Web3. A esto se le suma el uso de tecnología deepfake impulsada por Inteligencia Artificial (IA).

Las tecnologías anti-deepfake están lejos de ser perfectas

En 2020, la cantidad de videos deepfake conocidos llegó a 145,227, nueve veces más que el año anterior, según un informe de 2020 de Sentinel, una agencia de inteligencia de amenazas en Estonia.

Las tecnologías y los procesos que eliminan los videos falsos están lejos de ser infalibles. Otro reporte de Sensity descubrió que el 86% de las veces, las tecnologías anti-falsificación aceptaban videos ficticios como reales. Sin embargo, hay algunos signos reveladores de falsificaciones que incluyen un parpadeo extraño, un enfoque anormalmente suave alrededor de la piel o el cabello y una iluminación inusual.

«En estas entrevistas, las acciones y el movimiento de los labios de la persona que se ve en la cámara durante la entrevista no se coordinan completamente con el audio de la persona que habla. A veces, acciones como toser, estornudar u otras acciones auditivas no están alineadas con lo que está presentada visualmente».

FBI.

Finalmente, el FBI afirmó que las personas o empresas que han identificado intentos de deepfake deben informar los casos a su sitio web. Pero más allá del contexto legal, resulta alarmante que los profesionales recurran a estas tácticas para conseguir un puesto para el que quizá no estén capacitados.