La preocupación por los riesgos potenciales de los sistemas de inteligencia artificial (IA) ha llevado a los líderes de destacados laboratorios de IA, como OpenAI, Google DeepMind y Anthropic, a advertir sobre las posibles consecuencias letales asociadas con el desarrollo e implementación de estos sistemas en el futuro, según un informe del The New York Times.

Según estos líderes, existe un riesgo de extinción en la IA, es decir, las posibilidades de un desarrollo y evolución descontrolados podrían conducir a escenarios en los que la existencia y el futuro de la humanidad estén en peligro. Por esta razón, enfatizan la importancia de abordar estos riesgos a través de la implementación de políticas y regulaciones que fomenten un uso Responsable Socialmente (RS) y seguro de la IA.

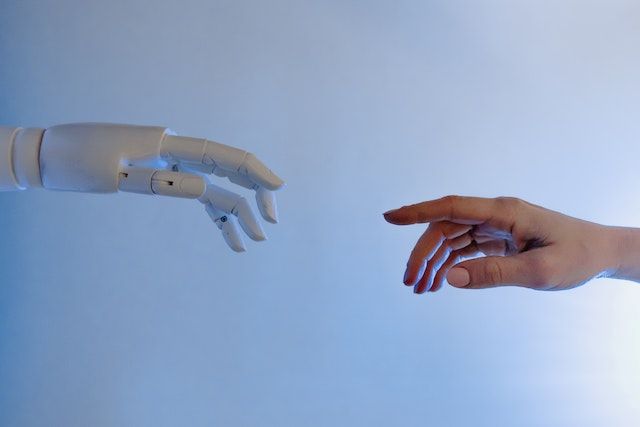

¿Es la IA una amenaza para la humanidad?

A la par de riesgos como las pandemias y las guerras nucleares, el grupo de líderes de la industria equiparó los peligros de la inteligencia artificial (IA) si no se toman medidas y regulaciones urgentes, así como acciones de seguridad adecuadas para mitigar posibles riesgos.

En una carta abierta, firmada por más de 350 ejecutivos, investigadores e ingenieros que trabajan en IA, y publicada por el Centro para la Seguridad de la IA, una organización sin fines de lucro, se lee: «Mitigar el riesgo de extinción de la IA debería ser una prioridad global, junto con otros riesgos a escala social, como las pandemias y la guerra nuclear».

Geoffrey Hinton y Yoshua Bengio, dos de los tres investigadores que ganaron el Premio Turing por su trabajo pionero en redes neuronales y que a menudo se consideran «padrinos» del movimiento moderno de la IA, firmaron la declaración, al igual que otros investigadores destacados en el campo.

Esta declaración llega en un momento de creciente preocupación por los daños potenciales de la IA. Los últimos avances en estos sistemas han generado temores de que su uso pueda asociarse a gran escala con la difusión de información errónea, o incluso la posibilidad de eliminar millones de empleos administrativos.

Riesgo de extinción en la IA: Especialistas

Con el tiempo, algunos creen que la inteligencia artificial (IA) podría volverse lo suficientemente poderosa como para crear trastornos a escala social en pocos años si no se toman medidas para ralentizar su avance, aunque los investigadores no siempre explican en detalle cómo podría suceder eso.

Estos temores son compartidos por numerosos líderes de la industria, lo que los coloca en una posición inusual al argumentar que una tecnología que están construyendo, y en muchos casos compiten intensamente para desarrollar más rápidamente que sus competidores, plantea riesgos graves y debe ser regulada de manera más estricta.

En este mes, Sam Altman, director ejecutivo de OpenAI; Demis Hassabis, director ejecutivo de Google DeepMind; y Dario Amodei, director ejecutivo de Anthropic, tres de los principales ejecutivos influyentes en empresas de IA, se reunieron con el presidente de los Estados Unidos, Joe Biden, y la vicepresidenta Kamala Harris para discutir sobre el riesgo de extinción asociado con la IA.

Durante su testimonio en el Senado, el Sr. Altman hizo hincapié en que los riesgos relacionados con los sistemas avanzados de inteligencia artificial eran lo suficientemente significativos como para requerir la intervención del gobierno. Expresó la necesidad de regular la IA debido a los posibles daños que podría causar.

¿Pone en riesgo la IA el futuro sostenible?

Dan Hendrycks, director ejecutivo del Center for AI Safety, una organización dedicada a la investigación y promoción de prácticas seguras y éticas en el campo de la inteligencia artificial, afirmó en una entrevista que la carta abierta es una especie de confesión por parte de algunos líderes de la industria sobre los riesgos que la IA plantea para la humanidad, los cuales deben abordarse en el contexto de los objetivos de desarrollo sostenible.

Según Hendrycks, este reconocimiento público es un paso importante para fomentar la discusión y la acción en la construcción de una IA más segura y responsable.

Sin embargo, existen escépticos que contradicen estos argumentos y señalan que la IA aún no está lo suficientemente desarrollada como para representar una amenaza existencial para la sociedad.

Por otro lado, algunos argumentan que la IA está mejorando rápidamente y que ya ha superado el rendimiento humano en algunas áreas, y que pronto lo superará en otras. Sostienen que la tecnología está demostrando su capacidad para igualar o superar el rendimiento humano en una amplia variedad de tareas, lo que podría significar el desplazamiento de empleos.

Construir una tecnología responsable socialmente

Con el fin de abordar el riesgo de extinción que representa la IA para la humanidad, se han propuesto varias medidas para gestionar estos sistemas inteligentes de manera responsable. Una de las propuestas es la creación de una organización internacional de seguridad de IA, similar a la Agencia Internacional de Energía Atómica, que establezca reglas y requisitos de registro y licencia gubernamentales para los fabricantes de IA a gran escala.

En resumen, la carta abierta y la opinión de los líderes de la industria son un llamado a la acción y a la colaboración con el gobierno, la sociedad y otras partes interesadas. El objetivo es evitar consecuencias negativas que pongan en riesgo el futuro sostenible y garantizar el uso socialmente responsable de la tecnología de IA.

La I.A. me plantea serias dudas, al igual que otras tecnologías, como la robótica, que van a una velocidad mayor que la del desarrollo humano de la mayoría (y me refiero a que dejo de lado a las élites intelectuales y económicas) sino a la gente común y corriente, que no puede asimilar o ir a la par, en sus trabajos y vida diaria, con estos avances. Estamos inmersos en una economía basada en un eterno crecimiento en un mundo finito, un robot puede producir más rápido y más eficientemente que un humano, pero este robot…¿consume?, el cerebro humano necesita pensar, como la musculatura el ejercicio, para desarrollarse y mantenerse ágil, crear las conexiones (sinapsis) entre las neuronas, mientras más pensamos-más conexiones-más rápido se encuentran las soluciones…a los problemas HUMANOS, un robot o una I.A. ¿se encontrará con problemas que solucionar?, las tareas rutinarias, pesadas, que exceden la capacidad física o aguante mental del ser humano, está bien, pero la redacción, la suma de 2+2, hoy hay jóvenes y no tan jóvenes que para sumar 1.200 + 400, recurren a una calculadora (celular, que reúne toda su capacidad de pensar)…simplemente porque está a la mano, si una máquina nos hace la tarea de redactar una carta, un oficio… ¿qué va a pasar?, frases y preguntas inconclusas a propósito. Tal vez mis dudas, para un experto, no tienen mayor asidero, pero las tengo, porque me da por pensar, me imagino un mundo lleno de robots e I.A., los primeros haciendo los trabajos y la otra pensando. E insisto, para la mayoría de nosotros. Una educación de calidad es lo que se necesita…para todos, un mundo más equilibrado, más justo.

Creo que las consideraciones respecto al futuro de la IA son inciertas, pero sí muy pertinentes. Generalmente la velocidad de la tecnología apabulla la ética y otras disciplinas importantes del devenir humano.